TL;DR:

- Bewertungsbots und Fake-Bewertungen verfälschen systematisch das Meinungsbild auf Plattformen wie Google oder Trustpilot. Unternehmen müssen rechtliche Vorgaben einhalten, durch Monitoring und Dokumentation verdächtiger Rezensionen frühzeitig gegen Fake-Bewertungen vorgehen. Hybride Erkennungssysteme kombinieren Zeit-, Profil-, Netzwerk- und Textsignale, um koordiniert agierende Fake-Bewertungen zu identifizieren.

In deutschen Messenger-Gruppen werden täglich hunderte Produkte gegen Fake-Bewertungen angeboten: Wer eine Bestellung aufgibt, bekommt sein Geld zurück und hinterlässt dafür eine Fünf-Sterne-Bewertung. Was nach einem harmlosen Tauschgeschäft klingt, ist für Unternehmensinhaber und Marketingverantwortliche eine ernste Bedrohung für ihre Online-Reputation. Bewertungsbots und organisierte Fake-Bewertungen verfälschen das Meinungsbild auf Google, Trustpilot und anderen Plattformen und zwingen Unternehmen, aktiv gegenzusteuern. Dieser Leitfaden erklärt konkret, wie diese Systeme funktionieren, was rechtlich gilt und welche Strategien zur Erkennung und Kontrolle wirklich helfen.

Inhaltsverzeichnis

- Mechanismen von Bewertungsbots und Fake-Bewertungen verstehen

- Rechtliche Rahmenbedingungen für die Erkennung von Bewertungsbots in Deutschland

- Technische Ansätze zur Detektion von Bewertungsbots: Signale und Frameworks

- Grenzen der Bewertungserkennung: Umgehung und Edge-Cases

- Praktische Tools und Ansätze zur Bewertungskontrolle im Unternehmenskontext

- Meinung: Was Marketingteams und Unternehmer aus der Bot-Erkennung lernen sollten

- Ihr nächster Schritt Richtung sichere Bewertungskontrolle

- Häufig gestellte Fragen zur Erkennung von Bewertungsbots

Wichtige Erkenntnisse

| Punkt | Details |

|---|---|

| Typische Mechanismen | Fake-Bewertungen entstehen oft durch koordinierte Aktionen und Dienstleisternetzwerke. |

| Rechtliche Vorgaben | Fake-Bewertungen sind in Deutschland verboten und müssen transparent überprüft werden. |

| Hybride Detektion | Effiziente Bot-Erkennung basiert auf mehreren Signalen, nicht nur auf dem Bewertungstext. |

| Edge-Cases beachten | Täter passen sich an und umgehen Systeme, weshalb Detektionsmuster regelmäßig aktualisiert werden sollten. |

| Tools und Strategie | Tools unterstützen die Überwachung, aber professionelle Einordnung und Kontrolle sind unverzichtbar. |

Mechanismen von Bewertungsbots und Fake-Bewertungen verstehen

Bewertungsbots sind automatisierte Programme oder koordinierte Netzwerke aus echten Menschen, die systematisch Bewertungen auf Plattformen wie Google oder Trustpilot erzeugen. Das Ziel: das Bewertungsprofil eines Unternehmens künstlich zu verbessern oder das eines Konkurrenten zu beschädigen. Wer die Mechanik dahinter kennt, erkennt die Muster schneller.

Koordinierte Netzwerke und Bestell-/Erstattungsmodelle

Das am weitesten verbreitete Modell funktioniert über sogenannte Bestell-und-Erstattungs-Schleifen. Anbieter in Telegram-Gruppen oder WhatsApp-Kanälen posten Produkte oder Dienstleistungen, die eine Bewertung benötigen. Interessenten kaufen das Produkt zum Vollpreis, hinterlassen eine positive Bewertung mit vorgegebenem Text und erhalten danach den Kaufpreis vollständig erstattet. Manchmal gibt es sogar eine Bonuszahlung obendrauf.

Diese Fake-Bewertungen werden über koordinierte Bestell-/Erstattungsmodelle und Dienstleisternetzwerke organisiert und sind damit kein Einzelphänomen, sondern ein strukturiertes Geschäftsmodell. In Deutschland wurden solche Gruppen mit bis zu 30.000 Mitgliedern dokumentiert, in denen täglich dutzende Angebote kursieren.

Was Dienstleister und Agenturen anbieten

Neben Netzwerken aus echten Menschen gibt es spezialisierte Dienstleister, die Fake-Bewertungen als Service verkaufen. Das Angebot umfasst oft:

- Vollständig ausformulierte Bewertungstexte mit individuellen Details und variiertem Schreibstil

- Profilfotos für Bewertungsprofile, um den Eindruck echter Kundschaft zu erwecken

- Zeitverzögerte Veröffentlichung von Bewertungen, um Häufungen zu vermeiden

- Paketpreise für mehrere Plattformen gleichzeitig

- Bewertungen mit spezifischen Keywords, um die lokale Suchsichtbarkeit zu beeinflussen

Die Qualität dieser Dienstleistungen hat sich in den letzten Jahren stark verbessert. Früher waren Fake-Bewertungen oft durch generische Texte wie "Sehr guter Service, gerne wieder" leicht zu erkennen. Heute imitieren viele Anbieter den Stil echter Kunden mit überzeugenden Details.

Wichtig zu verstehen: Selbst wenn ein Unternehmen selbst keine Fake-Bewertungen kauft, kann es Ziel organisierter Negativkampagnen durch Mitbewerber werden. Das macht das Thema für alle relevant, nicht nur für diejenigen, die aktiv eingreifen möchten.

Für Unternehmen, die ihre Bewertungsstrategie professionell aufstellen möchten, ist es entscheidend, zwischen echten, seriösen Bewertungsagenturen und dubiosen Anbietern zu unterscheiden. Der Unterschied liegt in der Transparenz, der rechtlichen Absicherung und den eingesetzten Methoden.

Rechtliche Rahmenbedingungen für die Erkennung von Bewertungsbots in Deutschland

Wer als Unternehmen mit Bewertungen arbeitet, ob es darum geht, eigene Bewertungen zu überwachen, verdächtige Rezensionen zu melden oder aktiv Bewertungsstrategien einzusetzen, muss den rechtlichen Rahmen kennen. Dieser hat sich durch die EU-Gesetzgebung in den letzten Jahren erheblich verschärft.

EU-Omnibus-Richtlinie und UWG: Was gilt heute

Fake-Bewertungen sind durch EU-Omnibus-Richtlinie und UWG explizit verboten. Die EU-Omnibus-Richtlinie, die seit dem 28. Mai 2022 in deutsches Recht umgesetzt ist, verpflichtet Unternehmen und Plattformen zu konkreten Maßnahmen. Das Gesetz gegen den unlauteren Wettbewerb (UWG) ergänzt diese Regelungen auf nationaler Ebene und macht Fake-Bewertungen zur abmahnfähigen Handlung.

| Rechtsgrundlage | Kernpflicht | Konsequenz bei Verstoß |

|---|---|---|

| EU-Omnibus-Richtlinie | Offenlegung, wie Bewertungen auf Echtheit geprüft werden | Bußgelder bis zu 4 % des Jahresumsatzes |

| UWG § 5 | Verbot irreführender Geschäftspraktiken inkl. Fake-Bewertungen | Abmahnungen, Unterlassungsklagen |

| UWG § 5a | Verbot des Verschweigens wesentlicher Informationen | Zivilrechtliche Schadensersatzansprüche |

| DSGVO | Datenschutz bei der Verarbeitung von Bewerterdaten | Bußgelder der Datenschutzbehörden |

Diese Rechtslage hat weitreichende Konsequenzen für Unternehmen. Wer auf seiner Website Bewertungen anzeigt, muss erklären können, wie diese auf Echtheit geprüft wurden. Wer Bewertungen aktiv beeinflusst, also kauft oder organisiert, ohne dies offenzulegen, riskiert empfindliche Strafen.

Praktische Schritte zur rechtssicheren Umsetzung

Rechtssichere Bewertungsstrategien erfordern klare Prozesse. Die folgende Schritt-für-Schritt-Anleitung hilft dabei:

- Dokumentation der Prüfmethoden: Legen Sie schriftlich fest, wie Sie Bewertungen auf Echtheit kontrollieren, auch wenn Sie nur Bewertungen anzeigen.

- Transparente Offenlegung: Informieren Sie Nutzer auf Ihrer Website, nach welchen Kriterien Bewertungen gefiltert oder angezeigt werden.

- Interne Richtlinie erstellen: Formulieren Sie klare Regeln, wer im Unternehmen Bewertungsanfragen stellen darf und wie.

- Plattform-Richtlinien kennen: Google, Trustpilot und andere Plattformen haben eigene Regelwerke, die zusätzlich zum Gesetz gelten.

- Rechtlichen Rat einholen: Bei der Umsetzung von aktiven Bewertungsstrategien lohnt sich die Beratung durch auf Wettbewerbsrecht spezialisierte Anwälte.

Rechtlicher Hinweis: Die Abgrenzung zwischen erlaubter Bewertungsförderung und unerlaubter Bewertungsmanipulation ist nicht immer eindeutig. Professionelle Beratung hilft, diese Grenze richtig einzuschätzen.

Wer rechtssichere Bewertungsstrategien konsequent umsetzt, reduziert nicht nur rechtliche Risiken, sondern stärkt langfristig auch das Vertrauen bei potenziellen Kunden.

Technische Ansätze zur Detektion von Bewertungsbots: Signale und Frameworks

Die technische Erkennung von Bewertungsbots ist komplex. Kein einzelnes Signal reicht aus. Moderne Plattformen und Detektionssysteme setzen daher auf hybride Ansätze, die mehrere Signalarten gleichzeitig auswerten.

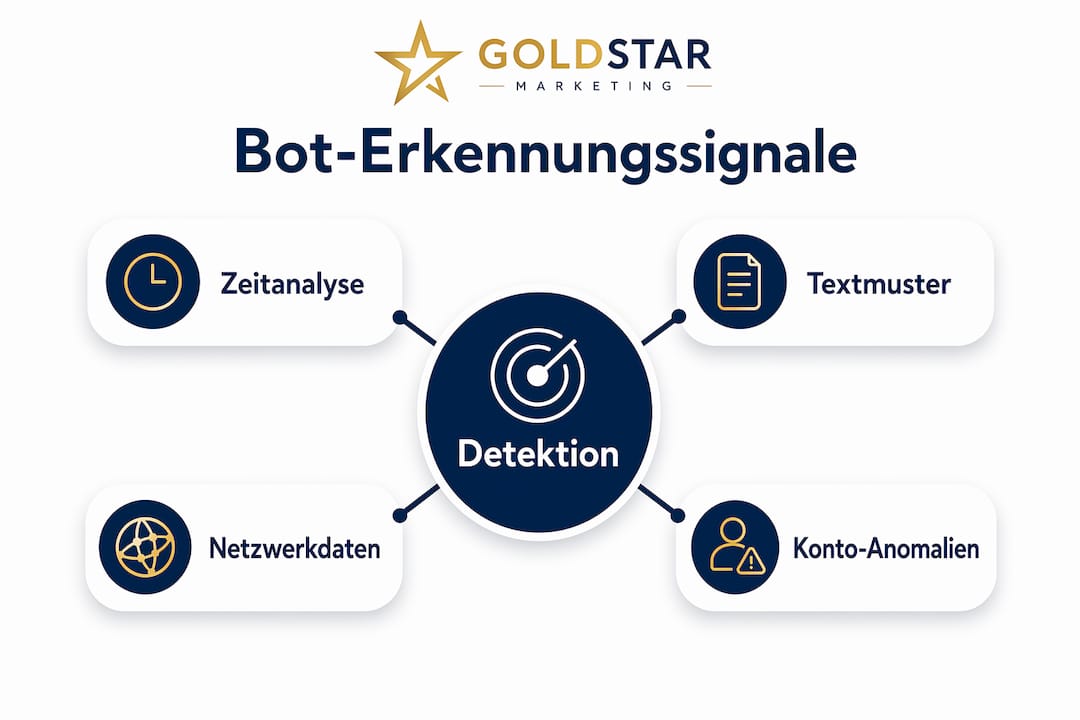

Vier Hauptkategorien von Detektionssignalen

Plattformen nutzen Muster über Zeit, Account-/Profilanomalien, Sprache sowie Netzwerk-/Geräteinformationen zur Erkennung verdächtiger Aktivitäten. Diese vier Kategorien bilden das Fundament moderner Detektionssysteme:

- Zeitsignale: Unnatürliche Häufung von Bewertungen innerhalb kurzer Zeiträume, zum Beispiel 20 Bewertungen innerhalb von 48 Stunden für ein kleines Lokal

- Verhaltens- und Profilsignale: Neue Konten ohne Bewertungshistorie, Profile ohne Profilbild oder mit generischen Nutzernamen, auffällig ähnliche Texte

- Netzwerksignale: Mehrere Bewertungen von derselben IP-Adresse oder demselben Gerät, geografische Anomalien bei lokalen Unternehmen

- Textsignale: Übertrieben positive Formulierungen, fehlende spezifische Details, Wiederholung von Schlüsselwörtern, unnatürlicher Schreibstil

Diese Signale wirken am stärksten in Kombination. Ein einzelnes neues Konto ist noch kein Beweis für einen Bot. Aber ein neues Konto mit einer einzigen Bewertung, verfasst in der gleichen Nacht wie 15 andere Bewertungen für dasselbe Unternehmen, aus derselben Region und mit einem sehr ähnlichen Text, das ist ein klares Muster.

Vergleich: Proof-of-Human vs. Device-only-Detektion

| Detektionsansatz | Stärken | Schwächen | Einsatzgebiet |

|---|---|---|---|

| Device-only-Signale | Einfach, schnell, automatisierbar | Umgehbar durch VPNs, Gerätewechsel | Erste Filterschicht |

| Verhaltensbasierte Analyse | Erkennt koordinierte Muster | Erfordert Verlaufsdaten | Mittelgroße Plattformen |

| Textanalyse mit KI | Skalierbar, schnell | Angreifbar durch Stilanpassungen | Inhaltsmoderation |

| Proof-of-Human-Verfahren | Sehr zuverlässig | Aufwendig für echte Nutzer | Hochrisikoumgebungen |

| Hybride Systeme | Höchste Erkennungsrate | Komplex in Implementierung | Große Plattformen |

Benchmark-Studien zeigen Leistungsunterschiede verschiedener Bot-Detektionssysteme erheblich, abhängig von der Sophistizierung der eingesetzten Bots und der Aktualität der Trainingsdaten.

Die Rolle von Bewertungen im Online-Marketing macht deutlich, warum Plattformen massiv in diese Systeme investieren: Falsche Bewertungen untergraben das Vertrauen aller Nutzer.

Profi-Tipp: Setzen Sie nicht auf eine einzelne Erkennungsmethode. Ein mehrstufiges Framework, das Zeitanalyse, Textprüfung und Netzwerksignale kombiniert, erkennt deutlich mehr verdächtige Aktivitäten als jede Einzelmethode. Denken Sie dabei auch an den Unterschied zwischen organischen vs. gekauften Bewertungen, um zu verstehen, welche Signale welche Art von Aktivität anzeigen.

Grenzen der Bewertungserkennung: Umgehung und Edge-Cases

Detektionssysteme sind gut, aber nicht perfekt. Wer diese Grenze kennt, kann realistische Erwartungen setzen und seine Strategie entsprechend anpassen.

Adaptive Täter und stilistische Tricks

Das größte Problem: Detektionssysteme lernen aus bekannten Mustern. Clevere Akteure beobachten, was erkannt wird, und passen ihr Vorgehen an. Detektionssysteme können durch stilistische Anpassungen und authentisch klingende Details überlistet werden. Das ist keine Theorie, sondern gelebte Praxis in der Branche.

Konkrete Umgehungsstrategien, die aktuell beobachtet werden:

- Zeitliches Strecken: Bewertungen werden nicht auf einmal, sondern über Wochen verteilt, um Häufungsanomalien zu vermeiden

- Authentische Details einbauen: Täter nennen spezifische Mitarbeiternamen, Menüpositionen oder Servicedetails, die sie vorab recherchiert haben

- Stilvariation durch KI: Moderne KI-Tools generieren Bewertungen in verschiedenen Schreibstilen, die menschlichen Texten kaum noch zu unterscheiden sind

- Profilaufwärmen: Fake-Accounts werden über Monate mit echten Bewertungen aufgebaut, bevor sie für koordinierte Aktionen eingesetzt werden

- Geräterotation: Jede Bewertung wird von einem anderen Gerät und einer anderen IP-Adresse abgegeben

Der sogenannte Edge-Case entsteht, wenn ein System entweder zu empfindlich oder zu tolerant eingestellt ist. Ist es zu empfindlich, blockiert es echte Kundenbewertungen, was das Vertrauen in die Plattform beschädigt. Ist es zu tolerant, schlüpfen Fake-Bewertungen durch.

Profi-Tipp: Behandeln Sie Detektionsregeln wie Software: Sie brauchen regelmäßige Updates. Vergleichen Sie mindestens vierteljährlich Ihre aktuellen Erkennungskriterien mit neuen Mustern aus der Branche. Wer Kundenbewertungen strategisch sammelt, versteht auch besser, welche Bewertungsmuster als normal und welche als verdächtig eingestuft werden sollten.

Was Unternehmen konkret tun können

Trotz der Grenzen sind Unternehmen nicht machtlos. Der Schlüssel liegt nicht darin, jede einzelne Fake-Bewertung zu identifizieren, sondern verdächtige Muster frühzeitig zu erkennen und konsequent zu handeln. Wer dokumentiert, meldet und nachfasst, hat bessere Chancen auf Entfernung als derjenige, der einzelne Rezensionen ohne Kontext an Plattformen meldet.

Praktische Tools und Ansätze zur Bewertungskontrolle im Unternehmenskontext

Nach dem Verständnis der Grenzen geht es um konkrete Werkzeuge, die im Unternehmensalltag realistisch einsetzbar sind.

Schritt-für-Schritt: Bewertungskontrolle aufbauen

- Regelmäßiges Monitoring einrichten: Richten Sie Benachrichtigungen für neue Bewertungen auf allen relevanten Plattformen ein. Reaktionsgeschwindigkeit ist entscheidend, besonders bei koordinierten Angriffen.

- Erstanalyse mit verfügbaren Tools: Tools wie Fakespot bieten eine schnelle erste Einschätzung. Allerdings: Fakespot ist ein Tool zum Prüfen von Bewertungen, jedoch nicht immer fehlerfrei und sollte als Hinweisgeber, nicht als abschließendes Urteil verstanden werden.

- Verdächtige Bewertungen dokumentieren: Speichern Sie Screenshots, Datum, Uhrzeit und Profildaten verdächtiger Bewertungen. Diese Dokumentation ist essentiell für spätere Meldungen und rechtliche Schritte.

- Plattform-Reporting nutzen: Google, Trustpilot und andere Plattformen haben spezifische Meldeprozesse. Nutzen Sie diese konsequent und mit präziser Begründung. Eine vage Meldung ohne Belege wird selten erfolgreich sein.

- Professionelle Einordnung einholen: Wenn Bewertungsmuster komplexer werden oder rechtliche Fragen entstehen, ist professionelle Unterstützung der effizientere Weg. Der Leitfaden zur Bewertungskontrolle bietet hier eine strukturierte Orientierung.

Profi-Tipp: Entwickeln Sie intern eine dokumentierte Kriterienliste für verdächtige Bewertungen. Zum Beispiel: Konto jünger als 30 Tage, keine Bewertungshistorie auf anderen Plattformen, Text enthält exakt die gleichen Keywords wie andere aktuelle Bewertungen, Zeitpunkt innerhalb von 12 Stunden nach einem Konkurrenz-Event. Solche Kriterien machen die Einschätzung schneller, konsistenter und leichter begründbar bei Plattform-Meldungen.

Welche Tools wirklich helfen

Neben Fakespot gibt es weitere Ansätze, die Unternehmen nutzen können. Review-Monitoring-Plattformen aggregieren Bewertungen über mehrere Plattformen hinweg und zeigen Auffälligkeiten in Diagrammen. Einige Anbieter integrieren einfache Anomalie-Erkennungen direkt in ihre Dashboards. Für die Textanalyse können KI-basierte Schreibstilanalysen helfen, aber auch hier gilt: Kein Tool liefert hundertprozentige Sicherheit. Die Kombination aus Tool-Einsatz, menschlicher Einschätzung und konsequentem Plattform-Reporting ist der einzig realistische Weg zu einem sauberen Bewertungsprofil.

Meinung: Was Marketingteams und Unternehmer aus der Bot-Erkennung lernen sollten

Nach Jahren praktischer Arbeit mit Bewertungsstrategien und Reputationsmanagement lässt sich eine klare Einschätzung formulieren: Die meisten Unternehmen unterschätzen die Komplexität des Problems, weil sie es vereinfachen.

Viele Marketingteams denken bei Fake-Bewertungen zuerst an den Text. Klingt der fake? Ist der Text zu generisch? Aber Text ist heute der am leichtesten manipulierbare Teil einer Bewertung. Bots können nicht allein durch Textanalyse erkannt werden, sondern benötigen Zeit- und Netzwerk-Checks. Das ist nicht nur eine technische Aussage, sondern eine strategische: Wer seine Erkennungsstrategie auf Textanalyse beschränkt, verliert den Kampf gegen adaptive Täter systematisch.

Was wirklich hilft, ist ein Mindset-Wechsel. Bewertungsbots sind kein Spam-Problem, das man einmal filtert und dann ist Ruhe. Sie sind ein kontinuierliches Katz-und-Maus-Spiel zwischen Plattformen, Tätern und Unternehmen. Wer dabei passiv bleibt, gibt die Kontrolle über seinen Online-Ruf ab.

Die zweite unterschätzte Lektion: Reputationssteuerung bedeutet nicht nur Abwehr. Unternehmen, die aktiv an ihrem Bewertungsprofil arbeiten, ein klares Monitoring betreiben, echte Kunden zur Bewertung animieren und bei problematischen Rezensionen schnell handeln, sind strukturell im Vorteil. Sie erkennen Anomalien schneller, weil sie ihr normales Muster kennen. Sie melden gezielter, weil sie dokumentiert haben. Und sie können professionell gegensteuern, wenn ein koordinierter Angriff beginnt.

Die dritte Lektion betrifft Benchmarks. Detektionsstrategien und Bewertungsstandards verändern sich schnell. Ein Ansatz, der 2024 noch sinnvoll war, kann 2026 überholt sein. Regelmäßige Überprüfung und Abgleich mit aktuellen Erkenntnissen aus der Branche sind keine optionalen Extras, sondern notwendige Routine. Wer Bewertungen im Online-Marketing als strategisches Werkzeug versteht, investiert auch in das regelmäßige Update dieser Strategie.

Die unbequeme Wahrheit lautet: Es gibt keine einmalige Lösung. Wer Bewertungsbots ernsthaft bekämpfen will, braucht ein mehrstufiges Monitoring, aktuelle Regelwerke, menschliche Einordnung und bei Bedarf professionelle Unterstützung. Das kostet Zeit und Ressourcen. Aber der Preis, nichts zu tun, ist langfristig höher.

Ihr nächster Schritt Richtung sichere Bewertungskontrolle

Das Wissen aus diesem Leitfaden ist ein solides Fundament. Aber Wissen allein schützt nicht Ihren Online-Ruf, wenn im Hintergrund koordinierte Akteure arbeiten. GoldStar Marketing unterstützt Unternehmen dabei, Bewertungsprofile aktiv und rechtssicher zu steuern, von der Analyse verdächtiger Muster über das Melden problematischer Rezensionen bis hin zur strategischen Positionierung Ihrer Bewertungen.

Wenn Sie negative oder gefälschte Bewertungen entfernen lassen möchten, erklärt unser Leitfaden zu Google Bewertungen löschen konkret, welche Optionen es gibt und wann welcher Weg sinnvoll ist. Für alle, die grundsätzlich über aktive Bewertungsstrategien nachdenken, bietet unsere Seite zu moralischen Bewertungskäufen eine ehrliche Einordnung. Und wer direkt lernen möchte, wie man Fakes im eigenen Profil identifiziert, findet im Bereich Fake-Bewertungen erkennen einen praxisnahen Einstieg. Sprechen Sie uns an, wir helfen Ihnen, Ihre Bewertungsstrategie auf ein stabiles Fundament zu stellen.

Häufig gestellte Fragen zur Erkennung von Bewertungsbots

Welche Signale sind für die Erkennung von Bewertungsbots am zuverlässigsten?

Mehrstufige Signale wie Zeitmuster, Account-Anomalien und Netzwerkdaten gelten als besonders effektiv, da Plattformen hybride Signale zur Erkennung kombinieren und kein einzelnes Signal allein ausreicht.

Sind alle Tools zur Analyse von Fake-Bewertungen zuverlässig?

Tools liefern nützliche Hinweise, sind aber nicht immer treffsicher, da Fakespot auch fehlerhafte Einstufungen liefern kann und besonders Edge-Cases, also adaptive Fake-Bewertungen mit authentischen Details, der Software oft entgehen.

Welche rechtlichen Pflichten bestehen für Unternehmen bezüglich Echtheitsprüfung?

Unternehmen müssen offenlegen, wie Bewertungen auf Echtheit geprüft werden, und dürfen keine Fake-Bewertungen beauftragen, da EU-Omnibus-Richtlinie und UWG Offenlegungspflichten und Verbote eindeutig regeln.

Wie reagieren Täter auf neue Detektionssysteme?

Fälscher passen ihren Schreibstil und spezifische Details gezielt an, um Systeme auszutricksen, da Umgehung durch stilistische Anpassungen ein bekanntes und dokumentiertes Phänomen in der Branche ist.

Wie kann ich als Unternehmen die Kontrolle über meine Bewertungen behalten?

Durch kontinuierliches Monitoring, intern dokumentierte Kriterien für verdächtige Rezensionen und bei Bedarf professionelle Services zur Prüfung und Löschung problematischer Bewertungen lässt sich die Kontrolle dauerhaft halten.